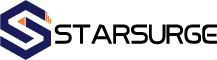

NVIDIA MCX555A-ECAT 100Gb/s однопортовый QSFP28 InfiniBand Adapter PCIe 3.0 x16 ConnectX-5 сетевая карта

Подробная информация о продукте:

| Фирменное наименование: | Mellanox |

| Номер модели: | MCX555A-ECAT |

| Документ: | CONNECTX-5 infiniband.pdf |

Оплата и доставка Условия:

| Количество мин заказа: | 1 шт. |

|---|---|

| Цена: | Negotiate |

| Упаковывая детали: | Внешняя коробка |

| Время доставки: | На основе инвентаризации |

| Условия оплаты: | Т/Т |

| Поставка способности: | Поставка по проекту/партии |

|

Подробная информация |

|||

| Статус продуктов: | Запас | Приложение: | Сервер |

|---|---|---|---|

| Состояние: | Новое и оригинальное | Тип: | Проводной |

| Максимальная скорость: | EDR и 100GBE | Разъем Ethernet: | QSFP28 |

| Выделить: | NVIDIA ConnectX-5 адаптер InfiniBand,Сетевая карта QSFP28 100 Гбит/с,Карта PCIe 3.0 x16 Mellanox |

||

Характер продукции

Высокопроизводительный сетевой адаптер 100 Гбит/с с низкой задержкой, разработанный для высокопроизводительных вычислений (HPC), ИИ и облачных центров обработки данных. Оснащен передовыми функциями разгрузки, включая NVMe over Fabrics, GPUDirect RDMA и сопоставление тегов для рабочих нагрузок MPI — обеспечивая ведущую в отрасли пропускную способность и эффективность использования ЦП.

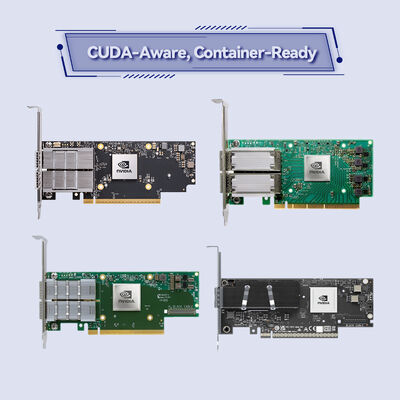

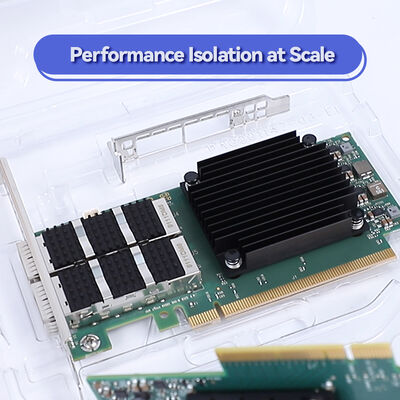

NVIDIA ConnectX-5 MCX555A-ECAT — это однопортовый адаптер InfiniBand 100 Гбит/с в низкопрофильном форм-факторе PCIe. Используя проверенную архитектуру ConnectX-5, он обеспечивает пропускную способность до 100 Гбит/с с задержкой менее микросекунды и высокой частотой сообщений. Карта поддерживает как InfiniBand (до EDR), так и 100GbE, обеспечивая универсальное подключение для высокопроизводительных вычислений, хранения данных и виртуализированных сред.

Встроенный коммутатор PCIe и расширенные возможности RDMA позволяют MCX555A-ECAT разгружать критически важные задачи связи с ЦП, обеспечивая более высокую производительность приложений, снижение энергопотребления и уменьшение общей стоимости владения. Он полностью совместим со слотами PCIe 3.0 x16 и поддерживает широкий спектр операционных систем и фреймворков ускорения.

- До 100 Гбит/с подключение на порт (InfiniBand EDR / 100GbE)

- Один разъем QSFP28 для оптических или медных кабелей

- Интерфейс хоста PCIe 3.0 x16 (автоматически согласовывается до x8, x4, x2, x1)

- RDMA, семантика отправки/получения с аппаратной надежной передачей

- Сопоставление тегов и разгрузка объединения для MPI и SHMEM

- Разгрузка целевых устройств NVMe over Fabrics (NVMe-oF) для эффективного хранения данных

- Ускорение GPUDirect RDMA (PeerDirect) для связи между ГП

- Аппаратное управление перегрузками и поддержка адаптивной маршрутизации

- Виртуализация SR-IOV: до 512 виртуальных функций

- Соответствие RoHS, низкопрофильный форм-фактор (в комплекте высокий кронштейн)

Архитектура ConnectX-5 включает ряд аппаратных движков ускорения, которые уменьшают вмешательство ЦП и повышают масштабируемость приложений:

- Сопоставление тегов MPI и разгрузка объединения: Разгружает сопоставление сообщений и обработку протокола объединения, значительно повышая производительность MPI для кластеров HPC.

- RDMA вне порядка с адаптивной маршрутизацией: Обеспечивает эффективное использование нескольких сетевых путей при сохранении семантики упорядоченного завершения, максимизируя использование сети.

- Разгрузка целевых устройств NVMe-oF: Позволяет системам хранения NVMe обслуживать удаленный доступ с минимальной загрузкой ЦП, идеально подходит для дезагрегированных архитектур хранения данных.

- Dynamically Connected Transport (DCT): Обеспечивает экстремальную масштабируемость для больших вычислительных систем и систем хранения данных, устраняя накладные расходы на установку соединений.

- ASAP2 Accelerated Switching & Packet Processing: Аппаратная разгрузка для Open vSwitch (OVS) и туннелирования оверлейных сетей (VXLAN, NVGRE, GENEVE).

- On-Demand Paging (ODP): Поддерживает страничную подкачку виртуальной памяти для операций RDMA, упрощая разработку приложений.

- Высокопроизводительные вычисления (HPC): Идеально подходит для суперкомпьютерных кластеров, симуляций на основе MPI и рабочих нагрузок научных исследований, требующих низкой задержки и высокой частоты сообщений.

- Обучение ИИ и глубокому обучению: В сочетании с GPUDirect RDMA обеспечивает быструю связь между ГП через узлы, ускоряя время обучения.

- Системы хранения данных NVMe-oF: Развертывается как целевые устройства хранения или инициаторы в средах NVMe over Fabrics для высокопроизводительного доступа к блочным данным с низкой задержкой.

- Облачные и виртуализированные центры обработки данных: SR-IOV и разгрузка виртуализации поддерживают многопользовательские среды с гарантированным качеством обслуживания (QoS) и безопасной изоляцией.

- Высокочастотный трейдинг (HFT): Сверхнизкая задержка и аппаратное временное меткирование (IEEE 1588v2) соответствуют требованиям приложений финансовых услуг.

MCX555A-ECAT разработан для широкой совместимости с коммутаторами NVIDIA InfiniBand (например, Quantum, Spectrum) и сторонними коммутаторами 100GbE. Он поддерживает как пассивные медные кабели DAC, так и активные оптические кабели через порты QSFP28.

Операционные системы и программные стеки:

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Data Plane Development Kit (DPDK) для обхода ядра

| Параметр | Спецификация |

|---|---|

| Модель | MCX555A-ECAT |

| Форм-фактор | PCIe Low-Profile (14,2 см x 6,9 см без кронштейна), высокий кронштейн предустановлен, короткий кронштейн в комплекте |

| Скорость и тип порта | 1x QSFP28, до 100 Гбит/с InfiniBand (EDR) и 100GbE |

| Интерфейс хоста | PCI Express 3.0 x16 (совместим с x8, x4, x2, x1) |

| Поддержка InfiniBand | Соответствие IBTA 1.3, 100 Гбит/с EDR, FDR, QDR, DDR, SDR; 8 виртуальных каналов + VL15; 16 миллионов каналов ввода-вывода |

| Поддержка Ethernet | 100GbE, 50GbE, 40GbE, 25GbE, 10GbE, 1GbE; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Возможности RDMA | RDMA over Converged Ethernet (RoCE), аппаратная надежная передача, RDMA вне порядка, атомарные операции |

| Разгрузка хранения | Разгрузка целевого устройства NVMe over Fabrics, iSER, SRP, NFS RDMA, SMB Direct, передача сигнатуры T10 DIF |

| Виртуализация | SR-IOV (до 512 виртуальных функций), VMware NetQueue, NPAR, службы контроля доступа PCIe (ACS) |

| Разгрузка ЦП | Статическая разгрузка TCP/UDP/IP, LSO/LRO, разгрузка контрольной суммы, RSS/TSS, вставка/удаление тегов VLAN/MPLS |

| Оверлейные сети | Аппаратная разгрузка для инкапсуляции/декапсуляции VXLAN, NVGRE, GENEVE |

| Управление | NC-SI через MCTP, PLDM для мониторинга/управления и обновления прошивки, I2C, SPI, JTAG |

| Удаленная загрузка | Удаленная загрузка через InfiniBand, Ethernet, iSCSI; поддержка UEFI, PXE |

| Энергопотребление | Не указано публично; типичный диапазон менее 20 Вт — пожалуйста, уточните для вашей системы |

| Рабочая температура | 0°C до 55°C (типичная среда) |

| Соответствие стандартам | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Примечание: Технические характеристики основаны на документации продукта NVIDIA ConnectX-5. Для получения самой последней информации и поддержки прошивки обратитесь к официальным заметкам о выпуске NVIDIA.

| Номер детали для заказа | Порты / Скорость | Интерфейс хоста | Форм-фактор | Ключевые особенности |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Гбит/с | PCIe 3.0 x16 | Низкопрофильный PCIe | Стандартный однопортовый, EDR InfiniBand / 100GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Гбит/с | PCIe 3.0 x16 | Низкопрофильный PCIe | Двухпортовый, EDR/100GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Гбит/с | PCIe 4.0 x16 | Низкопрофильный PCIe | ConnectX-5 Ex, улучшенный PCIe Gen4 |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Гбит/с | 2x PCIe 3.0 x8 | Socket Direct | Двухсокетное серверное соединение через кабель |

| MCX545B-ECAN | 1x QSFP28, 100 Гбит/с | PCIe 3.0 x16 | OCP 2.0 Type 1 | Форм-фактор Open Compute Project |

Для вариантов OCP или Multi-Host, пожалуйста, свяжитесь с отделом продаж. Все карты поддерживают обратную совместимость с более низкими скоростями.

- Превосходная производительность приложений: Аппаратная разгрузка для MPI, NVMe-oF и оверлеев освобождает ядра ЦП для бизнес-логики.

- Масштабируемая сеть RDMA: DCT, XRC и RDMA вне порядка обеспечивают линейную масштабируемость для тысяч узлов.

- Готовность к ускорению ГП: GPUDirect RDMA обеспечивает прямой доступ к памяти между ГП и сетевыми адаптерами, устраняя узкие места ЦП в кластерах ИИ.

- Гибкое развертывание: Один порт QSFP28 упрощает кабельную разводку и идеально подходит для архитектур «leaf-spine» 100 Гбит/с.

- Защита инвестиций: Поддержка как InfiniBand, так и Ethernet позволяет беспрепятственно переходить между протоколами по мере развития потребностей.

Hong Kong Starsurge Group предоставляет полную поддержку жизненного цикла адаптеров NVIDIA ConnectX-5, включая помощь в предпродажной конфигурации, руководство по обновлению прошивки и гарантийное обслуживание. Наша техническая команда может помочь с:

- Проверка совместимости с вашей серверной и коммутационной инфраструктурой

- Настройка производительности для рабочих нагрузок HPC или хранения данных

- Варианты пользовательских кронштейнов и требования к оптовой упаковке

- Обработка RMA и услуги расширенной замены

Свяжитесь с нашими инженерами по продажам для получения информации о ценах на объем и сроках поставки.

Электростатический разряд (ESD): Всегда соблюдайте меры предосторожности при работе с адаптером. Храните в антистатической упаковке до установки. Требования к охлаждению: Обеспечьте достаточный воздушный поток в корпусе сервера для поддержания рабочей температуры в указанном диапазоне. Обновление прошивки: Используйте официальные инструменты прошивки NVIDIA (MFT) и проверьте совместимость с вашей версией ОС и драйвера перед обновлением. Изгиб кабеля: Соблюдайте рекомендации по радиусу изгиба кабелей QSFP28, чтобы избежать ухудшения сигнала.

Это продукт класса А. В жилой среде он может вызывать радиопомехи. Обеспечьте надлежащее экранирование и заземление в соответствии с местными нормами.

Основанная в 2008 году, Hong Kong Starsurge Group Co., Limited является технологическим поставщиком сетевого оборудования, ИТ-услуг и решений по системной интеграции. Обслуживая клиентов по всему миру с продуктами, включая сетевые коммутаторы, сетевые карты, точки беспроводного доступа, контроллеры и высокоскоростные кабели, Starsurge сочетает глубокие технические знания с клиентоориентированным подходом. Компания поддерживает такие отрасли, как государственное управление, здравоохранение, производство, образование, финансы и корпоративный сектор, предлагая решения IoT, системы управления сетью, разработку пользовательского программного обеспечения и многоязычную глобальную доставку. Сосредоточившись на надежном качестве и оперативном обслуживании, Starsurge помогает клиентам создавать эффективную, масштабируемую и надежную сетевую инфраструктуру.

| Компонент / Система | Статус совместимости | Примечания |

|---|---|---|

| Коммутаторы InfiniBand NVIDIA Quantum | Сертифицировано | Совместимость EDR, HDR при использовании соответствующей прошивки |

| Коммутаторы Ethernet NVIDIA Spectrum | Сертифицировано | Поддерживаются режимы 100GbE, 50GbE, 25GbE |

| Сторонние коммутаторы 100GbE | Совместимо | Требуется соответствие стандартам IEEE; протестировано с основными поставщиками |

| Серверы ГП (NVIDIA DGX, HGX) | Сертифицировано с GPUDirect | Ускорение RDMA для связи между несколькими ГП |

| Массивы хранения данных с NVMe-oF | Поддерживается | Разгрузка целевого устройства обеспечивает эффективный доступ к сети NVMe |

- ☑ Подтвердите наличие в сервере свободного слота PCIe 3.0 x16 (или x8) с достаточным пространством.

- ☑ Определите количество портов: однопортовый (MCX555A-ECAT) против двухпортового (MCX556A-ECAT).

- ☑ Выберите тип кабеля: пассивный медный DAC для коротких расстояний (≤5 м) или оптический для более длинных трасс.

- ☑ Проверьте поддержку операционной системы и драйверов (OFED, Windows, VMware).

- ☑ Для кластеров ГП убедитесь в совместимости GPUDirect RDMA с вашей моделью ГП и версией драйвера.

- ☑ Проверьте, требуется ли высокий или короткий кронштейн для вашего серверного корпуса.

- NVIDIA MCX556A-ECAT — двухпортовый адаптер ConnectX-5 100 Гбит/с

- NVIDIA MCX556A-EDAT — ConnectX-5 Ex с поддержкой PCIe 4.0

- Коммутатор InfiniBand NVIDIA Quantum-2 QM9700 40 портов 800 Гбит/с

- Пассивные кабели Mellanox QSFP28 DAC (1 м, 2 м, 3 м)

- Коммутаторы Ethernet NVIDIA Spectrum-4 SN5600 100GbE/400GbE

- Руководство пользователя сетевого адаптера InfiniBand NVIDIA ConnectX-5

- Руководство по развертыванию RDMA over Converged Ethernet (RoCE)

- Рекомендации по использованию GPUDirect RDMA для кластеров ИИ

- NVMe over Fabrics с ConnectX-5 — руководство по настройке

- Руководство по установке и настройке OFED