NVIDIA Mellanox ConnectX-6 MCX653106A-HDAT двухпортовый адаптер InfiniBand 200 Гбит/с – PCIe 4.0 x16, In-Network Computing

Подробная информация о продукте:

| Фирменное наименование: | Mellanox |

| Номер модели: | MCX653106A-HDAT-SP |

| Документ: | connectx-6-infiniband.pdf |

Оплата и доставка Условия:

| Количество мин заказа: | 1 шт. |

|---|---|

| Цена: | Negotiate |

| Упаковывая детали: | Внешняя коробка |

| Время доставки: | На основе инвентаризации |

| Условия оплаты: | Т/Т |

| Поставка способности: | Поставка по проекту/партии |

|

Подробная информация |

|||

| Статус продуктов: | Запас | Приложение: | Сервер |

|---|---|---|---|

| Состояние: | Новое и оригинальное | Тип: | Проводной |

| Максимальная скорость: | До 200 ГБ/с | Разъем Ethernet: | КСФП56 |

| Модель: | MCX653106A-HDAT | Имя: | Сейф карты сети 200gbe MCX653106A-HDAT-SP Mellanox высокоскоростной умный |

| Выделить: | Сетевой адаптер Mellanox ConnectX-6,Интеллектуальный адаптер InfiniBand 200 Гбит/с,Сетевая карта PCIe 4.0 X16 |

||

Характер продукции

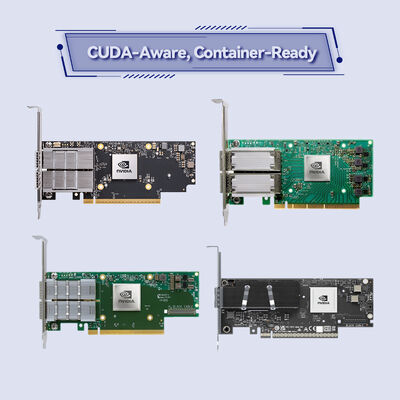

NVIDIA ConnectX-6 MCX653106A-HDAT 200 Гбит/с Двухпортовый инфинибандовый умный адаптер

Ведущая в отрасли 200Gb/s InfiniBand и Ethernet смарт-карта адаптера с двумя портами QSFP56, обеспечивающая ускорение вычислений в сети, шифрование на уровне блоков и PCIe 4.Интерфейс хоста 0 x16 для HPC, ИИ и облачных центров обработки данных.

- Подключение InfiniBand (HDR) или 200/100/50/40/25/10GbE с двумя портами 200Gb/s

- PCIe Gen 4.0 x16 (также совместим с Gen 3.0)

- Очищение аппаратного обеспечения: NVMe-oF цель/инициатор, XTS-AES 256/512-битная шифровка, совпадение меток MPI

- Поддержка NVIDIA In-Network Computing и GPUDirect RDMA

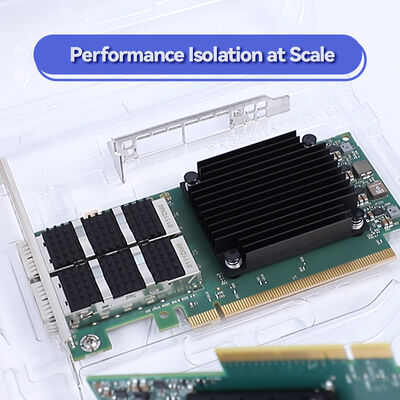

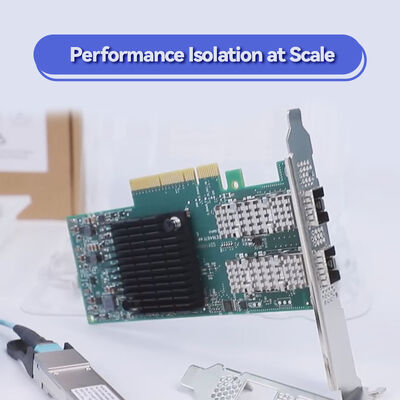

- Низкопрофильный форм-фактор PCIe, соответствующий требованиям RoHS

Характеристики

- Пропускная способность 200 Гбит/с:двойные порты, работающие со скоростью до 200 Гбит/с InfiniBand (HDR) или Ethernet с полной двунаправленной полосой пропускания.

- Компьютеры в сети:Отгружает коллективные операции (MPI, NCCL, SHMEM) с использованием технологии NVIDIA SHARP.

- Шифрование на уровне блока:аппаратное обеспечение AES-XTS для 256/512-битного шифрования/дешифрования без затрат на процессор; совместимо с FIPS.

- NVMe-oF отгрузки:Цель и инициатор разгружаются для NVMe через Fabrics, уменьшая использование процессора.

- Расширенная виртуализация:SR-IOV до 1K VF, ASAP2 ускорение для OVS и виртуального переключения.

Технологии и стандарты

MCX653106A-HDAT интегрируетСетевые вычисления NVIDIAдвигатели (SHARP),RDMA (IBTA 1.3),RoCE, иNVMe-oFОн поддерживаетPCIe Gen 4.0 (32 полосы как 2x16),PAM4 и NRZ SerDes, и расширенные функции, такие какДинамически связанный транспорт (DCT),По запросу (ODP), иАдаптивный маршрутизатор. Накладывание нагрузок для VXLAN, NVGRE, Geneve ускоряется аппаратным способом. Соответствует спецификациям IEEE 802.3bj, 802.3bm, 802.3by и InfiniBand Trade Association.

Рабочий принцип: "Умная архитектура отгрузки"

ConnectX-6 отгружает задачи связи и хранения с хост-CPU на аппаратное обеспечение адаптера.Для хранения, команды NVMe-oF обрабатываются непосредственно на адаптере, освобождая ядра процессора.более низкая задержка, более высокая скорость передачи сообщений (215 Мпп) и улучшенная масштабируемость приложений.

Приложения и развертывание

- Кластеры HPC:Симуляции на основе MPI, требующие низкой задержки и высокой скорости передачи сообщений.

- Обучение ИИ:NVIDIA GPU кластеры с GPUDirect RDMA и NCCL коллективов.

- Хранение NVMe-oF:Цель/инициатор разгрузки для высокопроизводительного доступа к хранилищу NVMe.

- Виртуализированные центры обработки данныхSR-IOV и ASAP2 для OVS-разгрузки в NFV и облаке.

- Серверы с несколькими сокетами:Конфигурации Socket Direct для обхода узких мест QPI/UPI.

Технические спецификации и варианты заказа

| Модель | Порты и скорость | Интерфейс хоста | Форма фактора | Шифрование | Протоколы | ОПН |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (200Gb/s IB/Eth) | PCIe 4.0 x16 (совместим с поколением 3) | PCIe stand-up (низкий профиль) | AES-XTS 256/512 бит | InfiniBand, Ethernet, NVMe-oF | MCX653106A-HDAT |

| ConnectX-6 | 1x QSFP56 (200 Гбит/с) | PCIe 4.0 x16 | PCIe в режиме стояния | AES-XTS | IB/Eth | MCX653105A-HDAT |

| ConnectX-6 | 2x QSFP56 (200 Гбит/с) | PCIe 4.0 x16 | ОЦП 3.0 | AES-XTS | IB/Eth | MCX653436A-HDAT |

Примечание: MCX653106A-HAT поддерживает 200Gb/s InfiniBand (HDR) и 200/100/50/25/10GbE. Размеры: 167.65mm x 68.90mm (без скобки).Расход энергии < 15 Вт.

Преимущества и отличительные черты

- против предыдущего поколения (ConnectX-5):Удвоить пропускную способность (200 Гбит/с против 100 Гбит/с), интегрированный SHARP для вычислений в сети и шифрование на уровне блоков.

- В сравнении с конкурентами:Истинная разгрузка оборудования для коллективов NVMe-oF и MPI, а не просто безгражданская разгрузка.

- Опция Socket Direct:Доступен для серверов с несколькими сокетами для устранения узких мест UPI / QPI.

- Соответствие FIPS:Аппаратное шифрование соответствует правительственным стандартам безопасности.

Обслуживание и поддержка

Мы предоставляем круглосуточные технические консультации, услуги RMA и поддержку интеграции для адаптеров ConnectX-6. Каждая карта имеет 1-летнюю гарантию.Наша команда обеспечивает проверку драйверов для основных дистрибутивов LinuxПоддержка предпродажной конфигурации для дизайна ткани InfiniBand доступна.

Часто задаваемые вопросы (FAQ)

Вопрос: совместим ли MCX653106A-HDAT с квантовыми коммутаторами скоростью 200 Гбит/с?

А:Да, он полностью совместим с коммутаторами NVIDIA Quantum QM8700/QM8790 и коммутаторами Quantum-2, когда используется режим HDR или NDR с соответствующими кабелями.

Вопрос: Может ли этот адаптер использоваться как для Ethernet, так и для InfiniBand?

А:Да, он поддерживает как протоколы InfiniBand, так и Ethernet.

Вопрос: Поддерживает ли он RoCE (RDMA over Converged Ethernet)?

А:Да, ConnectX-6 полностью поддерживает RoCE, обеспечивая низкую задержку RDMA в среде Ethernet.

Вопрос: Какова максимальная скорость передачи сообщений?

А:Адаптер доставляет до 215 миллионов сообщений в секунду, идеально подходит для небольших пакетов HPC.

Вопрос: Совместима ли карта со слотами PCIe Gen 3.0?

А:Да, он совместим с PCIe Gen 3.0 (x16), хотя пропускная способность будет ограничена ~100 Гбит/с на порт из-за ограничений Gen 3.

Осторожности и примечания о совместимости

- Требование слота PCIe:Для полной производительности 200 Гбит/с, устанавливайте в слоте PCIe Gen 4.0 x16.

- Охлаждение:Обеспечить адекватный воздушный поток в шасси сервера; пассивное охлаждение требует минимум 200 LFM.

- Проводка:Использовать QSFP56 пассивные/активные медные или оптические модули, рассчитанные на 200 Гбит/с (HDR).

- Поддержка водителя:Используйте новейшие NVIDIA MLNX_OFED для Linux или WinOF-2 для Windows.

- Рабочая температура:0°C - 70°C; хранить от -40°C до 85°C.

Введение компании

С более чем десятилетним опытом работы мы управляем крупной фабрикой, которую поддерживает сильная техническая команда.Наша обширная клиентская база и опыт в области позволяют нам предлагать конкурентоспособные цены без ущерба для качестваКак авторизованные дистрибьюторы Mellanox, Ruckus, Aruba и Extreme, мы имеем оригинальные сетевые коммутаторы, решения для сетевых карт, беспроводные точки доступа, контроллеры и кабели.Мы поддерживаем запасы в 10 миллионов долларов США, чтобы обеспечить быстрое выполнение различных линий продуктов.Каждая поставка проверяется на точность, и мы предоставляем круглосуточную консультацию и техническую поддержку.Наши профессиональные команды по продажам и технике заслужили высокую репутацию на мировых рынках..